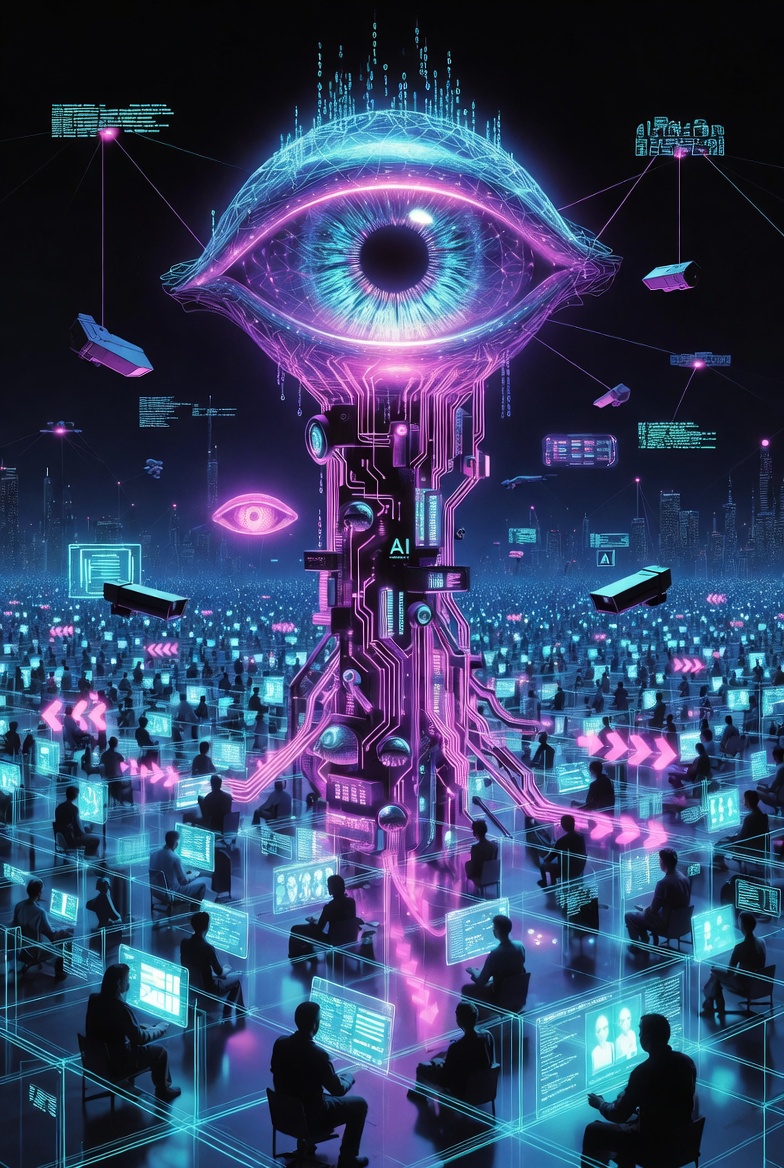

L’intelligenza artificiale avanza, ma non lo fa da sola: viene di pari passo con qualcosa di molto più inquietante, ovvero il consolidamento di una società della sorveglianza permanente. Non si tratta solo del fatto che gli algoritmi siano sempre più potenti, ma di chi controlla i dati con cui vengono alimentati e che tipo di mondo si costruisce a partire da essi.

Oggi, grosso modo, si delineano due grandi modelli.

Da un lato, il modello anglosassone, dove il potere di sorveglianza si concentra soprattutto nelle mani delle grandi corporazioni tecnologiche: Google, Meta, OpenAI, Anthropic e compagnia. Non hanno bisogno di prigioni fisiche né di sbarre: hanno bisogno di dati. La nostra cronologia di ricerche, i nostri clic, i nostri gusti, i nostri spostamenti, le nostre conversazioni. Tutto ciò diventa materia prima per sistemi di IA capaci di anticipare comportamenti, plasmare gusti, orientare decisioni di consumo e, sempre più, influenzare l’opinione pubblica e il voto.

Dall’altro lato, il modello statale autoritario, il cui esempio più citato è quello cinese, pone lo Stato al centro dell’architettura digitale e utilizza l’IA per organizzare, classificare e valutare i cittadini. Qui il confine tra “sicurezza”, “ordine sociale” e “controllo politico” si offusca pericolosamente. L’IA non è solo uno strumento economico, ma un’infrastruttura di potere: telecamere con riconoscimento facciale, sistemi di punteggio sociale, tracciabilità quasi totale di transazioni, spostamenti e relazioni.

A questi due modelli occorre aggiungere uno strato cruciale: i wearable e i dispositivi intelligenti che incorporiamo volontariamente nella nostra vita quotidiana. Occhiali intelligenti che vedono ciò che vediamo. Orologi che monitorano pulsazioni, sonno e attività fisica. Auricolari che captano la nostra voce tutto il giorno. Telefoni che registrano posizione, contatti, spostamenti, foto, abitudini. Sensori in casa, in macchina, al lavoro, in palestra. Una pioggia costante di dati biometrici, comportamentali e contestuali.

Se mettiamo tutto questo insieme, quello che abbiamo non è più solo sorveglianza: è quasi il sogno di Jeremy Bentham fatto realtà, il suo celebre Panopticon portato all’estremo. Nel progetto originale, una guardia poteva vedere tutti i detenuti da una torre centrale, mentre loro non sapevano mai se stessero venendo osservati in quel momento. Il risultato non era solo controllo esterno, ma autocontrollo interiorizzato: il soggetto finisce per comportarsi “come se” lo stessero sempre guardando. Oggi il Panopticon non è più una prigione circolare: è una rete digitale invisibile che ci avvolge.

La differenza è che ora non c’è un unico sorvegliante nella torre, ma molteplici: aziende, stati, algoritmi opachi. E, cosa più inquietante, non solo accettiamo questo sistema: spesso lo abbracciamo in cambio di comodità. “Ti do i miei dati in cambio che mi consigli meglio una serie, mi calcoli il percorso più rapido, mi velocizzi una pratica, mi monitori la salute.” Quella transazione, ripetuta milioni di volte, va consolidando una ipersorveglianza normalizzata.

In questo scenario, la grande domanda è: dove rimane l’Europa?

L’Europa, in teoria, cerca di occupare uno spazio intermedio. Da un lato, diffida del potere sfrenato delle big tech e cerca di porre limiti con normative sulla protezione dei dati, i diritti fondamentali e l’uso dell’IA. Dall’altro, non vuole neppure cadere in un modello statale di controllo totale alla cinese. Ma allo stesso tempo non può restare ai margini della corsa tecnologica: rinunciare all’IA e alla digitalizzazione significherebbe condannarsi all’irrilevanza economica, scientifica e sociale.

Questo colloca l’Europa in una sorta di bivio scomodo. Se si inclina troppo verso il modello corporativo anglosassone, rischia che i suoi cittadini finiscano per essere materia prima gratuita per piattaforme che non sono nemmeno europee, rafforzando una dipendenza digitale brutale. Se si sposta troppo verso il controllo statale, potrebbe scivolare in versioni morbide ma molto reali di sorveglianza amministrativa: cartelle sanitarie ipercentralizzate, pratiche pubbliche completamente digitalizzate che monitorano ogni interazione, profili di rischio automatizzati, punteggi di “affidabilità” finanziaria o sociale.

La digitalizzazione e l’automazione dei servizi pubblici è qui un punto chiave. Sulla carta, suona perfetto: pratiche più rapide, meno code, cartelle cliniche integrate, appuntamento medico in due clic, amministrazione “efficiente”. Ma sotto quello strato di efficienza si costruisce un sistema di tracciabilità totale: viene registrato cosa chiediamo, quando lo chiediamo, di cosa ci lamentiamo, quali aiuti richiediamo, quali malattie abbiamo, quali farmaci prendiamo, con quale frequenza ci rechiamo in un ufficio pubblico.

Se questi sistemi si connettono e si incrociano con dati bancari, di assicurazioni, di applicazioni per la salute, storie lavorative ed educative, il risultato è un ritratto iperpreciso di ogni persona. E quando entra l’intelligenza artificiale per “ottimizzare risorse”, “rilevare frodi” o “valutare rischi”, la tentazione è enorme: dare priorità ad alcuni cittadini rispetto ad altri, bloccare aiuti in modo automatizzato, contrassegnare profili “problematici” senza che nessuno possa facilmente contestarlo.

Tutto questo ci conduce a una ipersorveglianza quasi senza rimedio: un punto in cui uscire dal sistema è praticamente impossibile. Non avere un cellulare, non usare app, non accettare termini di servizio cessa di essere un’opzione realistica se si vuole accedere a sanità, istruzione, banca, trasporti o lavoro. È come cercare di vivere senza documento d’identità, ma in versione digitale.

Il paradosso è brutale: l’IA promette di aiutarci, curarci, proteggerci, semplificare la nostra vita… e allo stesso tempo restringe il margine di anonimato, di errore, di eccentricità, di dissenso. In un mondo in cui tutto viene registrato, ciò che non si adatta diventa sospetto. L’imprevedibile viene interpretato come rischio. Il diverso, come anomalia da correggere.

C’è una via d’uscita? Non è semplice, ma almeno ci sono due fronti indispensabili:

l’esigenza di istituzioni e leggi davvero forti che limitino l’uso dei dati, vietino certi tipi di sorveglianza e obblighino alla spiegabilità degli algoritmi;

e, soprattutto, mantenere viva una cultura del sospetto critico: non accettare senza riserve che ogni comodità tecnologica sia progresso, e ricordare che ogni “miglioramento” digitale ha un costo in autonomia e privacy.

Se non lo facciamo, il Panopticon di Bentham cesserà di essere una metafora filosofica e diventerà la descrizione fredda ed esatta del luogo in cui viviamo. E allora sì, la ipersorveglianza sarà l’aria stessa che respiriamo.

Lascia un commento